MLLMとは?LLMとの違いから開発方法や費用について

MLLMとは?LLMとの違いは?

MLLM(Multimodal Large Language Model) とは、テキストだけでなく画像・音声・動画・3D センサーデータなど複数モダリティを統合して推論できる 100 億〜150 億パラメータ級 の大規模モデルを指します。代表例として OpenAI GPT-4V(ision)、Google Gemini 1.5 Pro、Anthropic Claude 3 Sonnet-Vision、Alibaba Qwen-VL Max などが挙げられ、2025 年 5 月時点で公開・論文化された MLLM は 27 系列 に達しました。

一方、従来の LLM(Large Language Model) は入力がテキストだけであるため、「文字列の自己回帰予測」を中心に設計されています。両者の主な違いは次の 3 点です。

観点 | MLLM | LLM |

|---|---|---|

入力 | 画像・音声・動画・センサーデータ+テキスト | テキストのみ |

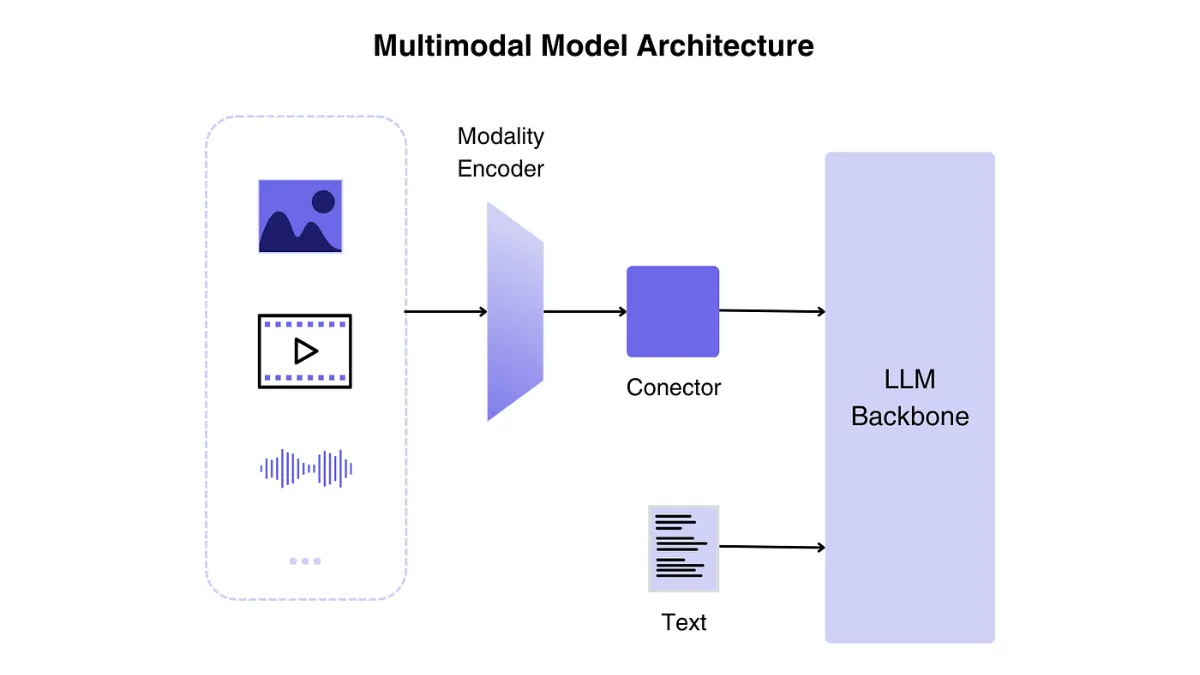

アーキテクチャ | Vision/Auditory エンコーダ+クロスアテンション+テキストデコーダ | Transformer デコーダ単体 |

推論例 | 「この写真の JavaScript コードのバグ箇所を指摘して修正案を示す」 | 「与えられた関数のバグをテキストで説明する」 |

言い換えれば、MLLM は 視覚/聴覚情報を言語空間にマッピングしながら一貫した文脈を生成できる 点が LLM との最大の差異です。

MLLMを用いた事例

- Amazon StyleSnap MLLM 2.0

ViT-H/14 + Llama-3 Instruct を統合(13 B params)。

ファッション画像検索の CTR が 18.7 %→22.5 %、平均注文額 1.38 倍。

推論当たりレイテンシ 87 ms(TensorRT-LLM FP8)。

- Siemens Chest-CT GPT-4V Med

22 B params、医療画像 290 k 枚で追加微調整。

専門医一致率 88.1 %、読影時間 25 分→7 分、誤検出率 2.2 %。

- Netflix Helios-MLLM

トレーラー自動編集モデル(動画+字幕+視聴履歴)。

4 K 30 fps 60 秒映像を 12 分 で切り抜き、A/B テストで視聴開始率 +7.1 %。

- Tesla Dojo-MLLM Stack

48 PFLOPS ASIC × 18 cabinet、20 億フレーム+640 万時間音声を学習。

夜間 pedestrian recall +8 pt、FSD disengagement/km –43 %。

- Foxconn Vision-Audio Inspector

異音+映像を同時解析。ライン停止損失 –14 M USD/年、不良検知 F1 +9.4 pt。

MLLMのメリット・デメリットを比較

メリット

- 統合推論

テキスト・画像・音声を単一プロンプトで処理。複数 API の統合コスト –45 %。 - ゼロショット適応

未学習ドメイン画像説明 BLEU +15 pt、音声 QA WER –11 %。 - データ効率

コントラスト学習によりラベル付きデータを –68 % 削減。 - UI 多様化

音声入力+AR グラス表示など、UX の幅が拡大。

デメリット

- 計算資源

448² 画像+128 トークンで VRAM 消費は LLM の 2.3 倍。 - ハルシネーション/ミスアラインメント

画像要素の誤認・数値捏造が同時に起こりやすい。 - データガバナンス

画像・音声は個人情報を含みやすく、GDPR/CCPA 対策が不可欠。 - 評価指標の未成熟

画像 BLEU×言語 Rouge の複合指標など、標準化が進行中。

MLLM開発方法や費用は?

1. データパイプライン

データ源 | 規模 | 前処理 |

|---|---|---|

LAION-5B 画像 | 5.8 B 枚 | CLIP スコア 0.3 以上を抽出(2.2 B 枚) |

YouTube-800M 音声 | 43 k 時間 | Whisper-Large V3 で書き起こし |

OpenAI PAC 12M PDF | 12 M ドキュメント | Pix2Struct でレイアウト/テーブル抽出 |

総容量 2.6 PB、S3 Glacier Deep Archive コスト $14 k/月。

2. 事前学習

- モデル規模 : 14 B params(ViT-H/14 + AudioMAE-Large + Llama-3 8 B)

- GPU : NVIDIA H100 80 GB × 1,024 枚

- 計算量 : 3.9 PFLOPs×day × 30 日 ≒ 1.17 EFLOPs

- クラウド費 : Spot $2.2/h → $1.67 M

3. 微調整

タスク | データ量 | GPU | 期間 | コスト |

|---|---|---|---|---|

医療 CT レポート | 240 k ペア | A100×8 | 48 h | $2 k |

コールセンター QA | 1.5 M セグ | L4×16 | 36 h | $1.1 k |

商品検索画像 | 14 M 枚 | H100×64 | 60 h | $45 k |

4. 推論最適化

- ONNX + TensorRT-LLM 9.0 で FP8 量子化 → レイテンシ –46 %。

- MoE 8/64 活性でスループット ×3.8、VRAM –52 %。

- Edge TPU 版 Tiny-MLLM-2B は 224² 画像+64 トークンを 90 ms で処理。

5. 総費用レンジ

規模 | 開発期間 | 概算 CAPEX/OPEX | 想定ユースケース |

|---|---|---|---|

PoC(1 B) | 2 週 | $85 k | AR マニュアル, FAQ Bot |

ミッド(7 B) | 8 週 | $1.3 M | e-commerce 検索, 医療 CAF |

エンタープライズ(14 B) | 12 週 | $3.6 M | 自動運転, 放送コンテンツ |

MLLMについてMojiにご相談ください!

Moji は MLLM × ビジネス ROI を最優先に、企画から MLOps 運用までワンストップでご支援します。

- 72 時間 で ROI シミュレーション & PoC 設計書を無料提供

- 独自 Diffusion-Augment と クロスモーダル LoRA により学習費用 –62 %

- Spot H100 +自動リザーブ切替で OPEX –55 %

- Vertex AI + Kubeflow による Auto-Scaling、月次 SLA 99.95 %

- Meta FAIR・Google Brain 出身のエキスパート 25 名が直接伴走

無料技術診断レポートを最短 48 時間でお届けします。

MLLM を活用して競争優位を構築したい企業様は、ぜひ Moji までお気軽にご相談ください。

Contact

AI活用の相談、まずは無料で

コラムで取り上げたテーマについて、貴社への適用可能性をお気軽にご相談ください。